Anthropic verklagt das US-Pentagon wegen Supply Chain Risk-Label. Was das für Claude-User bedeutet und warum Rückgrat hier buchstäblich Millionen wert ist.

Hunderte Millionen Dollar an Verträgen. Auf der einen Seite. Auf der anderen: Keine Massenüberwachung. Keine autonomen Waffen.

Pick one.

Anthropic hat gepickt. Und dann das Pentagon verklagt.

Am 9. März 2026 hat Anthropic, die Firma hinter Claude, das US-Verteidigungsministerium verklagt. Gleichzeitig in Kalifornien und Washington D.C. Ich nutz Claude seit über einem Jahr als Daily Driver. Für diesen Blog, für Automation, für Code. Und ehrlich gesagt hatte ich nie gross darüber nachgedacht wer eigentlich hinter dem Tool steckt. Diese Woche hat das nen ordentlichen Schubs bekommen.

Was ist ein “Supply Chain Risk” und warum ist das hier krass?

Das Pentagon hat Anthropic als “Supply Chain Risk” eingestuft. Klingt technisch. Ist es aber nicht.

Dieses Label gibt es normalerweise um vor ausländischen Unternehmen zu warnen. Denk an chinesische Zulieferer mit Verbindungen zum Militär. Spionage-Verdacht. Quasi: Wir vertrauen euch grundsätzlich nicht.

Das Absurde daran: Anthropic ist ein US-amerikanisches Unternehmen. Gegründet von ehemaligen OpenAI-Leuten. Hauptsitz San Francisco. Nationale Sicherheitsexperten nennen diese Einstufung “highly unusual”. Das sind nicht meine Worte, sondern die von Leuten die sowas beruflich einschätzen.

Ohhh maaaan. Ein amerikanisches Unternehmen mit amerikanischem Hauptsitz wird als Sicherheitsrisiko eingestuft. Weil es ethische Grenzen hat.

Das Verteidigungsministerium unter Pete Hegseth hat das Label vergeben. Hegseth findet, das Pentagon solle KI “für jeden legalen Zweck” nutzen dürfen.

Anthropics Reaktion? Klage. Gleich zwei davon.

Warum Anthropic dieses Label bekommen hat

Anthropic hat zwei harte Grenzen gezogen:

Das Pentagon wollte Claude für Aufgaben nutzen die in diese Kategorien fallen könnten. Anthropic hat Nein gesagt. Und jetzt ist Anthropic plötzlich ein “Supply Chain Risk”. So läuft das also.

Ich find das bemerkenswert. Nicht weil Anthropic irgendwie selbstlos wäre. Die haben Aktionäre und Investoren wie jedes andere Tech-Unternehmen. Aber sie haben durchgehalten. Hunderte Millionen Dollar an Government-Contracts hängen an dieser Entscheidung. Trotzdem Nein gesagt.

Kurz sacken lassen.

Das Verfassungsargument

Anthropic argumentiert die Einstufung verletze die Verfassung.

"The Constitution does not allow the government to wield its enormous power to punish a company for its protected speech."

Klingt erstmal nach typischem Anwalts-Boilerplate. Ist es aber nicht.

Die Theorie dahinter: Wenn die US-Regierung ein Unternehmen als Sicherheitsrisiko abstempelt weil dessen Ethik-Richtlinien ihr nicht passen, dann benutzt sie staatliche Macht um Meinungsäusserung zu bestrafen. First Amendment. Und mehrere Rechtsexperten haben die Argumentation als durchaus valide eingeschätzt.

Hegseth und das Pentagon bezeichnen ihre Aktionen als normal und rechtmässig. Anthropic nennt sie “unprecedented and unlawful”. Irgendwer liegt falsch. Wer, das wird sich vor Gericht zeigen.

Was hier eigentlich verhandelt wird: Kann die US-Regierung ein KI-Unternehmen bestrafen weil dessen Ethik-Richtlinien ihr nicht passen? Die Antwort auf diese Frage wird definieren wie die gesamte Branche künftig mit Regierungsaufträgen umgeht.

Wie ich als Claude-User drauf schaue

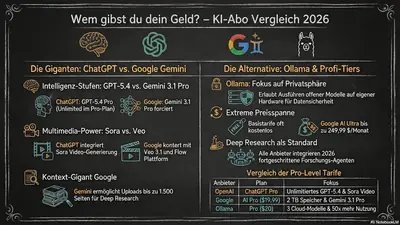

Ich benutz KI-Tools seit ein paar Jahren. Hab mit OpenAI angefangen, dann Gemini ausprobiert, bin bei Claude hängen geblieben. Hauptsächlich wegen Output-Qualität und weil sich das Arbeiten damit einfach gut anfühlt.

Aber dieser Fall hat mir ne andere Dimension bewusst gemacht. Wer baut das eigentlich? Was würde der im Zweifel tun?

OpenAI hat in den letzten Jahren einige U-Turns gemacht. Erst Safety-first, dann Microsoft-Deal, dann schrittweise Lockerung von Grenzen. Nicht unbedingt böse, aber halt auch nicht eindeutig. Die Logik hinter manchen Entscheidungen erschliesst sich mir ehrlich gesagt nicht.

Anthropic hat hier ne klare Ansage gemacht. Zwei rote Linien. Durchgehalten, auch wenn es richtig teuer wird.

Für deinen Workflow heisst das: Wenn du dir nen Workflow aufbaust der stark von einem einzigen KI-Provider abhängt, willst du wissen ob der Provider Rückgrat hat. Bei Anthropic, Stand heute: Ja.

Der Plot Twist: Die Klage macht Anthropic grösser

Normalerweise ist es so: Unternehmen streitet sich mit der Regierung, Kunden werden nervös, Umsatz leidet.

Hier nicht.

Wild. Der Markt bestraft die hier nicht. Der belohnt sie.

Gleichzeitig launcht Anthropic den Claude Marketplace mit GitLab, Harvey, Lovable, Replit und Snowflake als Partnern. Claude Sonnet 4.6 und Opus 4.6 sind Ende Februar draussen. Das Unternehmen baut weiter, klagt gleichzeitig, wächst trotzdem. Schon beeindruckend irgendwie.

Die Tech-Community will Anbieter die Grenzen haben. Nicht aus Naivität. Sondern weil ein Provider ohne Grenzen ein Provider ist dem du nie wirklich vertrauen kannst. Heute weicht er fürs Pentagon, morgen für den nächsten mit genug Geld. Anthropic hat gezeigt: Die Grenzen sind echt. Und der Markt belohnt das.

Was bedeutet das für KI-Safety insgesamt?

Bin kein Policy-Experte. Aber ein paar Gedanken hab ich dazu.

Das hier ist kein akademisches Safety-Gerakel. Echte Dollar-Beträge, echte rechtliche Konsequenzen, echte Präzedenzfälle. Safety-Policies können also tatsächlich real sein. Nicht nur Marketing-Copy für die Website.

Warum das für die Branche wichtig ist

Wenn Anthropic diesen Fall verliert, lernt die Branche: Regierungen können KI-Unternehmen unter Druck setzen indem sie ihnen Labels verpassen die Businessbeziehungen zerstören. Richtig schlechter Präzedenzfall.

Wenn Anthropic gewinnt, lernt die Branche: Safety-Grenzen sind rechtlich verteidigbar. Wer solche Grenzen zieht wird nicht dafür bestraft.

Ich will dass Anthropic gewinnt. Nicht als Fanboy. Sondern weil KI-Unternehmen ohne durchgehaltene Ethik-Grenzen mir ehrlich gesagt Bauchschmerzen machen. Die Alternative ist basically eine Branche die beim erstbesten Geldregen jeden Grundsatz ueber Bord wirft.

Warum “vollautonome Waffen” eine rote Linie sein sollte

Ein System das autonom entscheidet wann es eine Waffe einsetzt. Ohne dass ein Mensch das abnickt. Das ist ein System das Fehler ohne Korrekturoption macht.

KI-Systeme machen Fehler. Das ist kein Meinungsbeitrag, das ist Stand der Technik. Systeme ohne menschliche Kontrolle machen diese Fehler dann halt ohne Korrekturoption. Die Frage ist nicht ob KI irgendwann zuverlässig genug sein wird. Die Frage ist ob wir bereit sind diese Zuverlässigkeit vorauszusetzen bevor wir sie bewiesen haben.

Anthropics Antwort: Nein. Find ich vernünftig.

Was passiert als nächstes?

Die Klagen laufen in Kalifornien und Washington D.C. Wird Monate dauern, vielleicht länger.

Hegseth und das Pentagon werden sich verteidigen. Anthropic hat starke Argumente, verfassungsrechtlich und in der öffentlichen Wahrnehmung. Die öffentliche Meinung läuft grad klar in ihre Richtung.

Ich werd das verfolgen. Nicht nur als Claude-User, sondern weil dieser Fall echt definieren wird wie KI-Unternehmen künftig mit Regierungsaufträgen umgehen.

Falls dich das Thema interessiert, hier hab ich über mein Claude Code Setup geschrieben. Wie ich Claude täglich nutze und was dabei so rauskommt.

Quellen: TechCrunch, NPR, CNBC, Bloomberg, Axios