15 Jahre Fotografie, ADHS und KI-Tools: Mein kompletter Workflow mit AfterShoot, Lightroom, Photoshop, Luminar Neo und Topaz AI im ehrlichen Praxistest.

15 Jahre Fotografie. Tausende Hochzeiten. Und ein ADHS-Hirn das nach jedem Shooting vor 4.000 RAW-Dateien sitzt und innerlich stirbt. Kennst du das? Stundenlang Regler schieben, Bilder sortieren, die Konzentration irgendwo zwischen dem dritten Kaffee und nem YouTube-Video über Ameisenfarmen verloren. Das nervt einfach massiv.

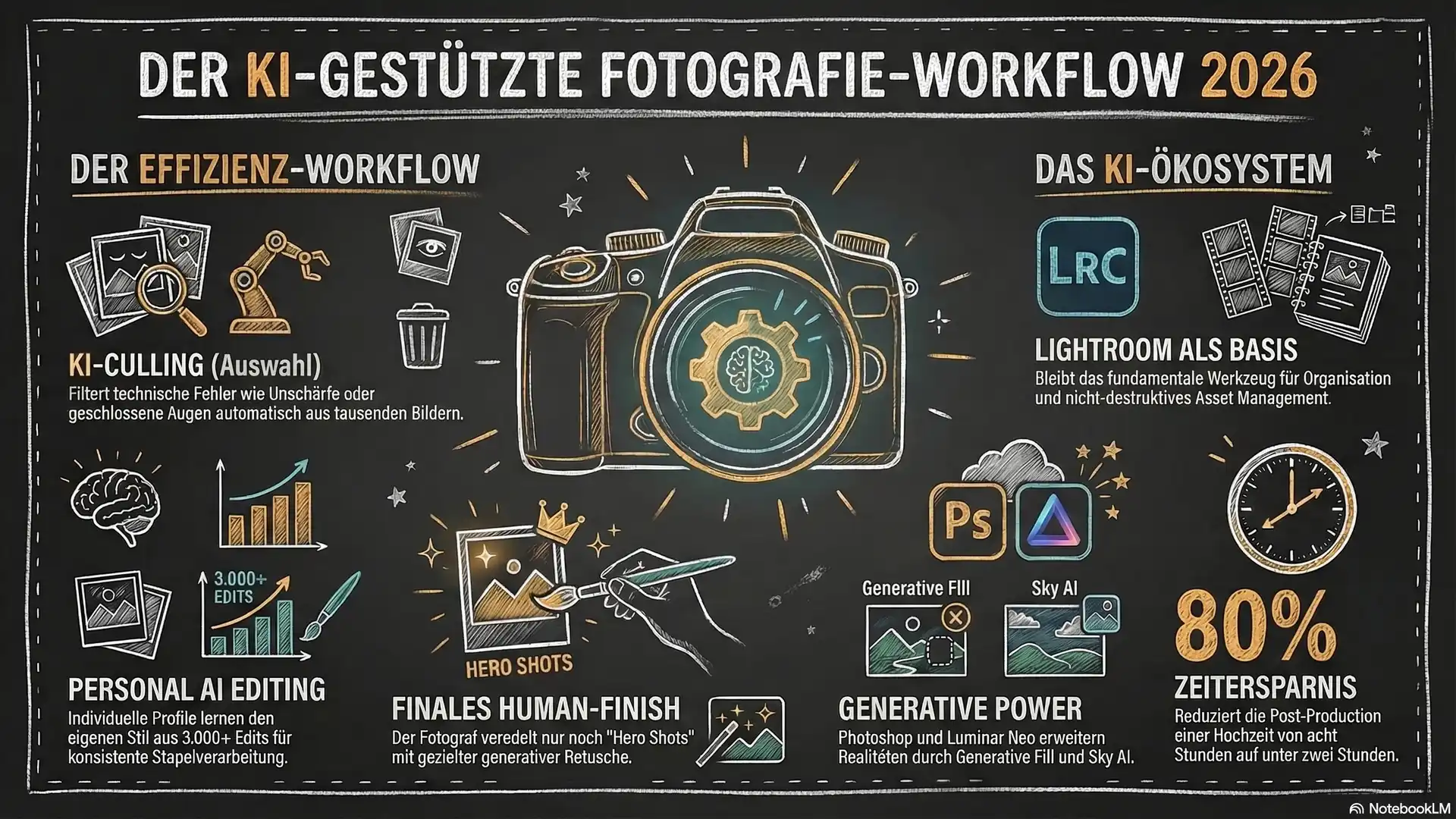

Post-Production war der stille Killer meines Geschäfts. Nicht mehr Geld verdienen als man wegarbeiten kann. Das ist kein Feature, das ist ein Bug. Aber 2026 hat KI das komplett gedreht. Das hier ist kein trockenes Tech-Review. Ich bin kein YouTuber der Plugins testet. Das ist ein ehrlicher Erfahrungsbericht von jemandem, der täglich mit ki bildbearbeitung arbeitet. Basically: KI hat mich nicht ersetzt. Sie hat meine Erschöpfung ersetzt.

Damals vs. Heute: Vom Regler-Sklaven zum Creative Director

Erinnerst du dich noch an alte Post-Production? Jedes Bild einzeln anfassen. Regler schieben. Schieber-nach-oben, Schieber-nach-unten. Entscheidungsmüdigkeit des Todes. Das ist pure Energieverschwendung.

Für ADHS-Leute der Endgegner.

Ich versuch’s mal mit der Feynman-Methode: Stell dir vor, du musst eine riesige Wand streichen. Früher hast du jeden Millimeter mit einem winzigen Pinsel selbst abtupfen müssen. Mühsam. Fehleranfällig. Mittendrin fragst du dich: „Warum mache ich das eigentlich?” Heute sagst du einem schlauen Roboter-Assistenten einfach: „Streich das Wohnzimmer blau, lass die Fensterrahmen weiß.” Der Roboter macht die Drecksarbeit perfekt. Du schaust zu und passt hin und wieder auf, dass die Farbe stimmt.

Das ist der Wechsel, der mir mein Leben zurück gegeben hat.

Früher: Ich war ein Regler-Sklave. 90 % der Zeit? Belichtung. Sättigung. Weisspunkt. Kontrast. Highlight-Recovery. Ein Bild nach dem anderen.

Heute: Ich bin der Creative Director meines eigenen Workflows. Die KI macht die Drecksarbeit. Ich entscheide die Richtung. Das ist echt geil.

AfterShoot: Der Brain-Saver für Culling & Looks

Nach einer Hochzeit mit 4.000 RAWs nach Hause kommen. Dein Hirn ist Matsch. Komplett am Ende. Das ist normale Fotografie. Und hier ist AfterShoot mein absoluter Fokus-Retter.

Was AfterShoot beim Culling macht

Das Ding analysiert über 30 Bildattribute. Schärfe. Belichtung. Gesichtsausdruck. Komposition. Es erkennt doppelte Fotos automatisch und stapelt sie. Blink-Detection checkt, ob Augen offen sind. Das ist ernst gemeint—die KI weiß, wenn jemand gerade beim Lächeln mit den Augen blinzelt.

Für mich bedeutet das: Ich muss nicht mehr zwischen fünf fast identischen Fotos wählen. AfterShoot macht den ersten Pass. Rauswerfen was rausmuss. Ich checke nur noch die „Best Ofs”. Das spart mir Stunden. Mindestens.

Bei Hochzeiten aktivier ich Spezialfilter für bestimmte Motive. Kussszenen erkennen. Gruppenfotos bewerten. Das funktioniert erstaunlich gut, muss ich sagen.

Der eigene Look: Training mit echten Bildern

Du kannst ein eigenes KI-Profil trainieren. Ich hab das gemacht mit 20 meiner Hochzeiten. Das sind ca. 5.000+ fertig bearbeitete Bilder aus echten Jobs. AfterShoot liest die Metadaten dieser Bilder und lernt quasi meine DNA. Mein Farbraum. Mein Kontrastfeel. Meine Sättigung.

Der Stil ist „halbwegs okay”. Muss ich ehrlich sagen. Es macht eine gute Grundlage. Statt von Null anzufangen, hab ich jetzt einen Startpunkt der… ok ist. Danach muss ich trotzdem über alle Bilder drüber. Feinheiten einstellen. Aber: Das nimmt mir extreme Menge Zeit bei der Grundentwicklung ab. Statt eine Stunde pro Bild bin ich in 15 Minuten mit der Basis-Bearbeitung durch.

Mein ehrliches Problem mit AfterShoot

Und jetzt die unschöne Wahrheit: Nach mehreren Jahren bin ich unsicher, ob ich es weiter nutze. Klingt komisch, weiß ich. Aber das ist mein echtes Problem: Culling dauert trotzdem noch extrem lange. Manchmal bin ich schneller, wenn ich alles in einem Rutsch selbst durchmache, statt erst AfterShoot laufen zu lassen, dann die Ergebnisse zu checken, dann nochmal selbst durchzusehen.

Das ist nicht Pollos Verschuldung. Das ist die Realität von ki bildbearbeitung 2026: Die Tools sind nicht perfekt. Sie sind echt gut. Aber sie ersetzen dich nicht komplett. Du brauchst trotzdem eine zweite Schicht Mensch-Augen.

Falls du AfterShoot ausprobieren willst: Hier gibt's 10% Rabatt über meinen Link (Affiliate-Link, ich bekomme eine kleine Provision, du sparst 10%)

Lightroom: Das Gummi-Tool für Fehler

Lightroom ist immer noch das Zentrum meines Workflows für professionelle ki bildbearbeitung. Aber es ist jetzt extrem KI-aufgeladen.

Generative Remove: Lightrooms Radiergummi

Der Name ist Programm. Da steht ein Mülleimer im Bild. Ein Telefondraht quer über die Komposition. Eine unerwünschte Person im Hintergrund. Ein Klick—weg.

Die KI erfindet Pixel, die wirklich zur umgebenden Textur passen. Der Himmel wird weitergezogen. Gras wird nachgeneriert. Steinmauern werden fortgesetzt. Das ist nicht grob, nicht fuzzy. Das sieht aus, als wäre das Ding nie da gewesen.

Ich nenn das selbst immer „das Gummi-Tool”, weil es sich so anfühlt: Radiergummi, Fehler weg, Leben ist gut. Für 90 % meiner Fehler-Sekunden reicht das völlig aus.

Adaptive Masken: Automatisches Selektieren

Zähne bleichen. Himmel maskieren. Augen aufhellen. Das passiert jetzt automatisch. Adaptive Masken checken die Bildkomposition und trennen Motive sauber ab. Himmel erkannt—done. Zähne erkannt—done. Augen erkannt—done.

Ich muss nur noch kurz drüber schauen. Basically ein Klick, fertig. Das fummelige Maskieren von Hand—das mein ADHS-Fokus früher nie überlebt hat—das ist vorbei.

Photoshop: Generative Fill für die Hero Shots

Photoshop nutze ich nicht mehr für den ganzen Schwung, das wäre Overkill. Aber für die wichtigen Einzelbilder? Absolut stark.

Bilder erweitern statt croppen

Stell dir vor: Du hast ein geniales Porträt. Vertical Format. Perfekt. Aber dein Kunde braucht es als horizontales Web-Banner für seine Website. Früher? Croppen oder neu fotografieren. Heute: Photoshop. Generative Expand.

Die KI erfindet den Rest der Location einfach dazu. Sie achtet auf Lichtrichtung. Unschärfe. Background-Textur. Es sieht aus, als hätte ich das Foto damals genau so komponiert.

Das ist echt geil für solche kreativen Korrektionen, die früher Stunden gedauert hätten. Teils brauchte ich mehrere Takes, bis das Ergebnis passte. Das ist ein Feature das vielleicht 5-10 mal pro Job hilfreich ist. Aber wenn es hilfreich ist? Gold.

Was die Generative Fill bei mir macht

Ich seh ein Foto von ner Hochzeit, ein Bräutigam von vorne, aber links ist der Rand abgeschnitten. Arm weg. Schulter weg. Mit Generative Fill: Ich wähle den Bereich aus, und die KI ergänzt die fehlende Schulter basierend auf der anderen Seite und der Belichtung. Das ist richtig, richtig geil wenn es klappt. Und ja, manchmal brauche ich ein paar Anläufe. Aber der Kreativität ist da kein Ende gesetzt.

Luminar Neo: Das Spielzeug für Einzelbilder

Luminar Neo ist quasi mein Spielplatz für Einzelbilder. Ich nutze es nicht für 4.000 Fotos, weil der Ressourcenverbrauch echt krass ist. Dein Rechner läuft nach 10 Bildern auf Höchsttemperatur. Aber für die besten 10-20 eines Shootings? Unschlagbar.

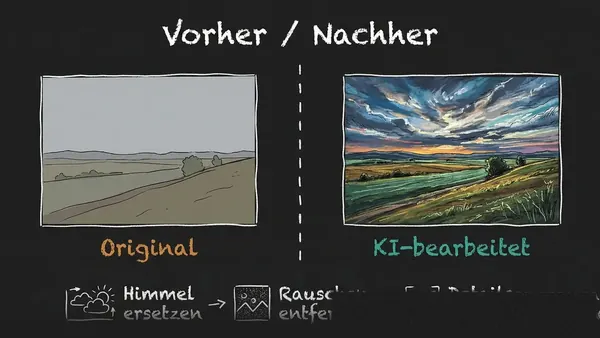

Sky AI: Himmel ersetzen mit Lichtanpassung

Der Himmel war grau. Uninspiriert. Sky AI tauscht ihn aus und passt das komplette Licht im Vordergrund an—inklusive Reflexionen in Pfützen. Das ist nicht einfach eine Himmel-Textur drübergeklebt. Das ist eine ki bildbearbeitung die versteht, dass wenn der Himmel heller wird, der ganze 3D-Raum heller wird.

Relight AI: Belichtung im 3D-Raum korrigieren

Mit Relight AI kannst du die Richtung von Licht im Bild verschieben. Die Hauptperson war im Schatten? Relight hebt sie auf, ohne den Hintergrund zu versaufen. Das funktioniert, weil die KI versteht wo die Lichtquellen sind und wie sie auf die Szene wirken.

Ein echtes Feature für kreative Effekte. Nicht Alltag. Aber wenn du es brauchst, bist du dankbar.

Topaz Photo: Der Hausmeister meines Archivs

Topaz ist mein Spezialist für die technische Seite von ki bildbearbeitung—die Rettung für Patzer die beim Shooting passieren.

Denoise: Rauschen entfernen ohne Details zu verlieren

Hochzeiten im Ballsaal. Schummriges Licht. Du ballst den ISO hoch, schießt das Bild, und es rauscht wie ein Fernseher aus den 80ern. Topaz Photo hat einen Autopilot der das analysiert und das Rauschen weg-KI’d ohne die Details zu verschwimmen.

Das ist nicht Photoshops klassischer Noise-Reduction-Filter. Das ist KI die versteht: Was ist Rauschen (wegmachen) und was ist echte Textur (stehen lassen).

Standard MAX Upscaling: Details die es nie gab

Ein Kunde will einen riesigen Print. 1x1 Meter. Von einem winzigen 50%-Ausschnitt deines Bildes. Das geht normalerweise nicht. Zu wenig Pixel. Topaz Photo hat ein Modell (Standard MAX, oder Wonder Model für kleine Auflösungen) das neue Details generiert. Nicht erfunden. Extrapoliert. Das sieht nicht fake aus, das sieht aus wie eine größere Version desselben Bildes.

Das rettet mir regelmäßig den Hintern. Kunde möchte Ausschnitt doch A3-groß. Boom. Topaz.

Midjourney: Visionen vor der Kamera

Bevor ich überhaupt die Kamera anfasse, nutze ich Midjourney. Früher habe ich Stunden damit verbracht, Stockfotos zu suchen. Pinterest. Unsplash. iStock. Boards anlegen. Die richtige „Stimmung” rausfinden.

Heute generiere ich einfach selbst.

Ich beschreib der KI die Lichtstimmung. „Cinematic lighting. Foggy forest. Golden hour. Couple kissing.” Sekunden später habe ich 4 Bilder die zeigen, was mein Kunde kaufen hat—welche Stimmung ich anstrebe. Kein reales Foto, aber Inspiration für das echte Shooting. Und die Kundin sieht: Ach, so ne Lichtstimmung willst du gar nicht. Zu düster. Zu viel Fog.

Das spart mir ehrlich Stunden in der Vorbereitung. Echt geil, um eine visuelle Richtung vorzugeben, ohne selbst ein einziges Foto gemacht zu haben. Und Midjourney: Wärmstens empfehlen. Das ist mit die beste KI-Bilderstellungssoftware auf dem Markt. Punkt.

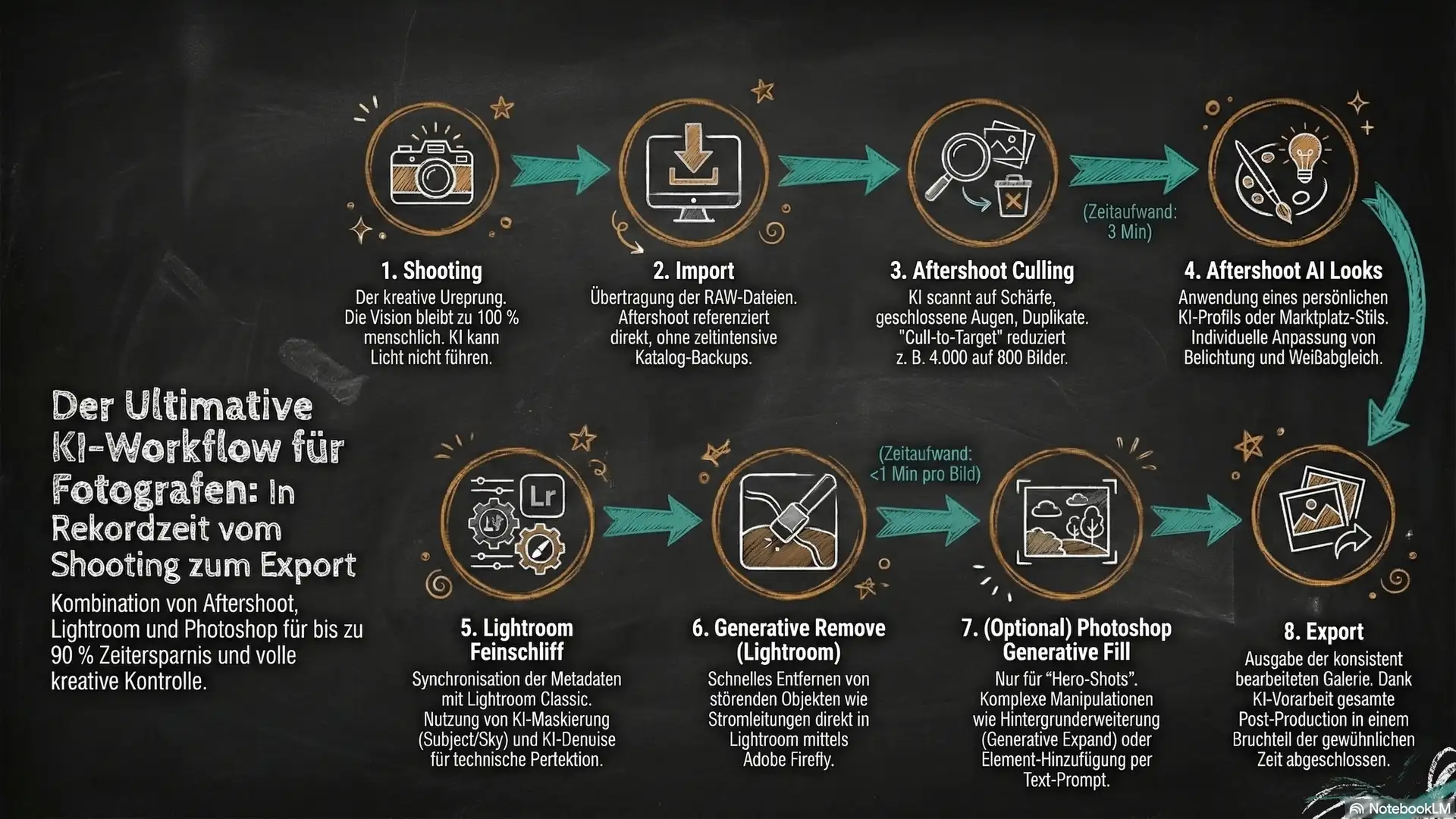

Der Workflow in der Praxis: So sieht ein Arbeitstag aus

Ein Hochzeitstag ist vorbei. 4.000 RAWs auf der Karte. Das ist mein Workflow Schritt für Schritt:

Tag 1, Abend: Import in Lightroom. AfterShoot Culling starten (lädt im Hintergrund). Ich mach was anderes. Essen. Bett.

Tag 2, Morgens: AfterShoot ist durch. Ich scroll durch die „Best Ofs” (ca. 800 Bilder sind jetzt noch übrig statt 4000). Noch mal manuell aussortieren—was ist wirklich best, was nur gut? Bleiben ca. 400.

Tag 2, Mittags: AfterShoot-Look anwenden. Die KI macht Basis-Bearbeitung. Alles hat jetzt ungefähr die gleiche Farbtemperatur, Kontrast, Sättigung. Gut genug für Entwurf.

Tag 2-3, Nachmittags: Ich geh durch alle 400, verfeinere Farbstiche, hol Details zurück, entferne Fehler mit Lightroom Generative Remove. Für Hero Shots geh ich in Photoshop und erweitere wenn nötig.

Tag 3, Abends: Final-Export in Web-Qualität, Upload zur Cloud, fertig.

Das ist nicht 2 Wochen Arbeit mehr. Das ist 2 Tage.

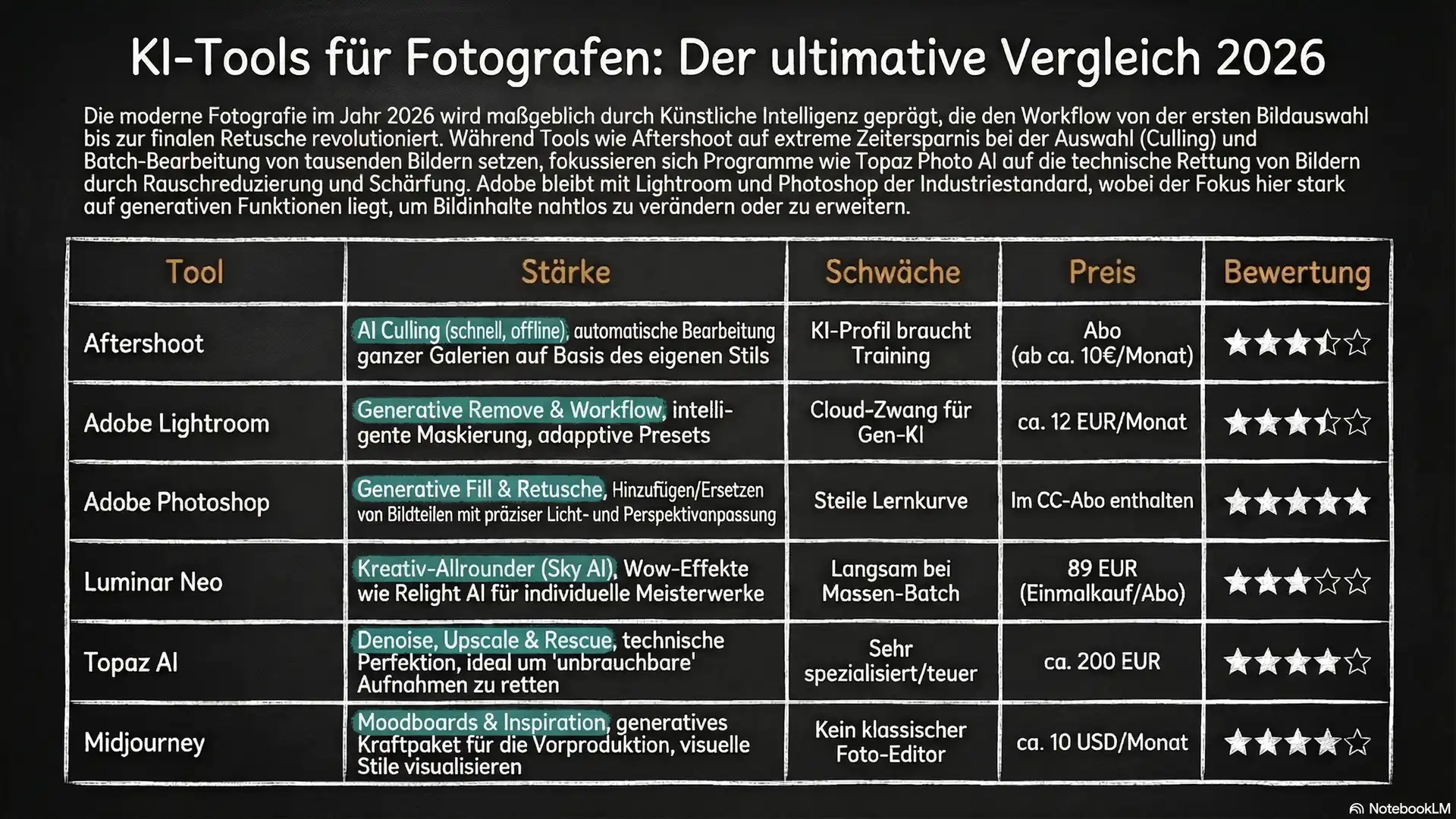

Die Kosten: Ist es das wert?

Ja. Aber ki bildbearbeitung ist nicht kostenlos.

| Tool | Preismodell 2026 | Hauptnutzen | Wertung |

|---|---|---|---|

| AfterShoot | ~12€/Monat | Culling, AI Looks | Geil (aber unsicher) |

| Topaz Photo | ~199€/Jahr | Denoise, Upscaling | Stark |

| Adobe Foto-Abo | ~20€/Monat | Lightroom + Photoshop + Firefly | Geil |

| Luminar Neo | ~79€/Jahr | Kreative Effekte | Geil (hardware-hungrig) |

| Midjourney | ~20€/Monat | Moodboards, Vision | Geil |

| Evoto (optional) | ~0,14€/Export | High-End Porträt-Retusche | Stark |

Das summiert sich. ~50€/Monat für alle Tools zusammen. Für nen einzelnen Hochzeitsjob (verdien ich sagen) ist das nix. Für nen Studio-Betrieb ist das eine Investition in die Effizienz.

Und ja, alles ist Abo-basiert. Das ist nicht günstig. Du brauchst das Mindset: Das ist nicht Kauf, das ist ein Geschäfts-Tool, das dich schneller macht.

Wenn du 4 Hochzeiten pro Monat machst? ROI ist positiv. Wenn du 1 Hochzeit pro Monat machst? Das musst du selbst rechnen.

Was nervt noch immer

Lüfter. AfterShoot lädt lokal auf deinem Rechner. Das ist super für Datenschutz—deine Hochzeitsfotos gehen nicht auf fremde Server. Aber deine GPU wird beim Culling und beim Look-Training zur Höchsttemperatur gebracht. Meine Lüfter klingen wie nen Düsenflugzeug.

Es gibt Alternativen die Cloud-basiert sind (wie Imagen von Adobe). Aber für mich persönlich: Ich bin oft unterwegs, nicht immer im stabilen Internet. Local Processing ist mir lieber.

Und noch etwas: Die Tools sind nicht magisch. Sie machen Fehler. Generative Remove kann halluzinieren. Adaptive Masken schneiden manchmal falsch. Das ist nicht neu, das ist normal bei KI. Du brauchst immer noch Human Eyes. Immer noch Geschmack. Immer noch Entscheidungen.

Zukunft: Eigene Tools mit Claude Code

Das hier wird euch wahrscheinlich nächstes Mal im Blog zu lesen sein, aber: Ich plane gerade ein Python-Script mit Claude Code. Die Idee: AfterShoot exportiert meine 5-Sterne-Auswahl. Das Script spiegelt diese automatisch in einen verschlüsselten Cloud-Backup-Ordner. Das spart mir das manuelle Dateimanagement, das mich früher immer wahnsinnig gemacht hat.

Langfristig? Ich kann mir vorstellen, dass ich ein einfaches Open-Source-Tool baue. Vielleicht kein Full Replacement für AfterShoot oder Adobe. Aber ein ki bildbearbeitung-Tool das speziell für Fotograf:innen konzipiert ist. Mit Claude. Mit lokaler GPU-Nutzung. Mit Fokus auf Workflow statt Featurecreep.

Das ist noch Zukunftsmusik. Aber das ist die Richtung in der ich denk.

Fazit: KI als Fokus-Helferin, nicht als Ersatz

Wir schreiben 2026 und wer noch ohne ki bildbearbeitung arbeitet, verschwendet nicht nur Zeit, sondern seine gesamte kreative Energie. Punkt. Das ist keine feine Optional-Aufrüstung mehr, das ist quasi Standard für professionelle Fotografie.

Mein persönlicher ADHS-Hack: ki bildbearbeitung hat mir ein Superkraft gegeben. Nicht die Superkraft, schneller zu sein—das auch. Aber die Superkraft, nicht komplett auszubrennen. Die Fähigkeit, den Creative Director zu spielen, statt ein Regler-Sklave zu sein. Die Möglichkeit, am Freitagabend noch Energie für mein Leben zu haben.

Aber bei allem Tech-Gerede: Die künstlerische Vision bleibt bei dir. Die KI schiebt nur die Regler. Du sagst ihr, in welche Richtung. Du entscheidest, ob das Bild geil ist oder nicht. Du suchst die Motive aus, du kompontierst. Die KI macht die nervige Post-Production-Drecksarbeit, die dich früher 10 Stunden pro Tag gekostet hat.

Das ist nicht zukunft, das ist jetzt.

Bleib fokussiert (oder versuch’s zumindest).

— TRMT